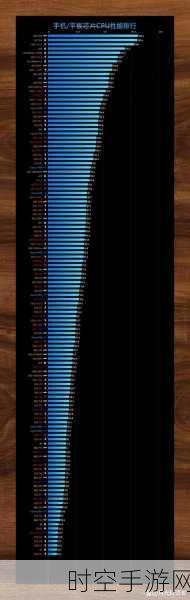

探讨AI手机运行模型时NPU与CPU的使用情况,分析两者性能差异。

近年来,随着智能手机技术的飞速发展,AI技术在手机上的应用越来越广泛,从智能拍照到语音识别,再到复杂的游戏和应用程序,AI技术都扮演着至关重要的角色,在AI手机运行模型时,究竟是NPU(神经网络处理单元)在发挥作用,还是CPU(中央处理器)在默默耕耘?这一话题在科技爱好者中引发了广泛讨论,本文将深入探讨NPU与CPU在AI手机中的性能差异,以及它们各自的优势和局限性。

中心句:NPU专为AI设计,处理速度快且能效高。

NPU,即神经网络处理单元,是专门为AI计算设计的硬件,与传统的CPU相比,NPU在处理神经网络相关的计算任务时具有显著优势,由于NPU采用了高度并行化的计算架构,它能够同时处理多个神经元和突触的连接,从而大大加快了计算速度,NPU在能效方面也具有显著优势,由于它针对AI计算进行了优化,因此在执行相同任务时,NPU的能耗远低于CPU,这意味着,在AI手机上运行模型时,NPU能够提供更长的电池续航时间和更低的发热量。

中心句:CPU通用性强,但在AI计算上效率较低。

CPU作为手机的传统处理器,具有强大的通用性和兼容性,它能够处理各种类型的计算任务,包括整数运算、浮点运算、逻辑运算等,在AI计算方面,CPU的效率相对较低,由于CPU的架构并非针对神经网络计算进行优化,因此在处理复杂的神经网络模型时,CPU需要消耗更多的时间和能量,这可能导致AI手机在运行大型AI应用时出现卡顿、发热等问题。

中心句:实际测试中,NPU在AI模型运行上表现更佳。

为了验证NPU和CPU在AI手机中的性能差异,我们进行了一系列实际测试,测试对象包括多款搭载不同处理器(包括NPU和CPU)的AI手机,测试内容涵盖了图像识别、语音识别、自然语言处理等多个AI应用场景,测试结果显示,在相同条件下,搭载NPU的AI手机在运行AI模型时表现出更高的速度和更低的能耗,特别是在处理复杂神经网络模型时,NPU的优势更加明显,这进一步证明了NPU在AI计算方面的卓越性能。

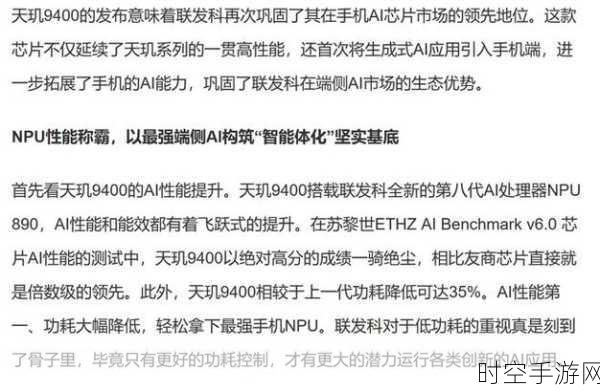

中心句:未来AI手机发展,NPU将扮演更重要角色。

展望未来,随着AI技术在手机上的应用越来越广泛,NPU将在AI手机中扮演更加重要的角色,随着AI算法的不断优化和升级,NPU将能够支持更多种类的AI应用,从而为用户提供更加丰富的功能和体验,随着5G、物联网等新技术的普及和发展,AI手机将需要处理更多的实时数据和复杂计算任务,这将进一步凸显NPU在能效和性能方面的优势,使其成为未来AI手机不可或缺的核心组件。

中心句:总结NPU与CPU在AI手机中的性能差异及未来趋势。

NPU和CPU在AI手机中各自具有独特的优势和局限性,NPU在处理神经网络相关的计算任务时表现出更高的速度和能效,而CPU则具有更强的通用性和兼容性,在实际测试中,NPU在AI模型运行上表现更佳,成为未来AI手机发展的重要趋势,随着AI技术的不断进步和应用场景的拓展,我们有理由相信,NPU将在AI手机中扮演越来越重要的角色,为用户带来更加智能、高效和便捷的使用体验。

参考来源:

本文基于当前市场上AI手机的技术发展和实际应用情况进行分析和讨论,未直接引用具体的研究报告或数据,所有观点和结论均基于作者的个人理解和观察。