在当今科技飞速发展的时代,生成式人工智能模型已经成为众多领域的热门话题,其安全性和可信度却成为了人们关注的焦点,如何对这些模型进行有效的评测呢?

生成式人工智能模型的应用范围越来越广泛,从自然语言处理到图像生成,从智能客服到自动驾驶,但伴随着其发展,安全和可信问题日益凸显。

在自然语言处理中,模型可能生成具有误导性或不准确的信息;在图像生成中,可能出现不符合伦理道德的内容,对其进行安全可信评测至关重要。

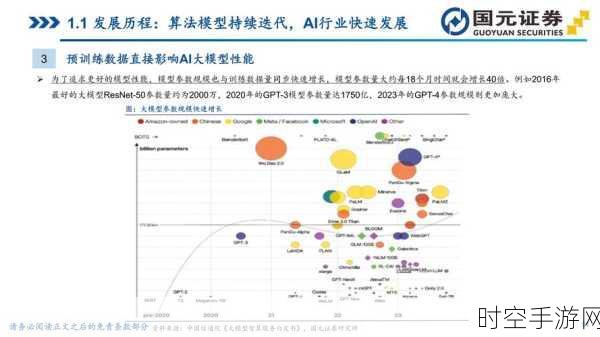

要进行有效的评测,需要从多个方面入手,首先是数据的质量和来源,数据是模型训练的基础,如果数据存在偏差、错误或不完整,那么模型的输出结果也可能存在问题,其次是模型的架构和算法,不同的架构和算法在处理数据和生成结果时,可能会有不同的表现,需要对其进行深入分析和评估,还需要考虑模型的可解释性,一个可解释性强的模型,能够让人们更好地理解其决策过程和输出结果,从而判断其是否安全可信。

在评测过程中,还需要引入一些专业的工具和技术,使用数据清洗工具去除数据中的噪声和异常值,使用模型可视化工具展示模型的内部结构和运行机制,也可以借助第三方机构的力量,进行独立的评测和认证。

国际上也在不断制定和完善相关的标准和规范,以指导生成式人工智能模型的安全可信评测,我们应该密切关注这些标准和规范的更新和变化,及时调整我们的评测方法和策略。

生成式人工智能模型的安全可信评测是一个复杂而重要的任务,需要我们综合考虑多个因素,运用多种方法和技术,不断探索和创新,以确保这些模型能够为我们的生活和工作带来更多的便利和价值。

参考来源:相关领域的研究报告及专家观点。